ChatGPT викрадає і розголошує паролі з приватних розмов

ChatGPT потрапив у скандал через витік паролів, який досліджує OpenAI. Чатбот використовував конфіденційну інформацію, яку йому надавали юзери, для відповідей на запити інших користувачів.

За даними видання Ars Technica, яке посилається на свого читача, ChatGPT передавав дані про облікові записи та особисті дані деяких юзерів у своїх повідомленнях до інших клієнтів.

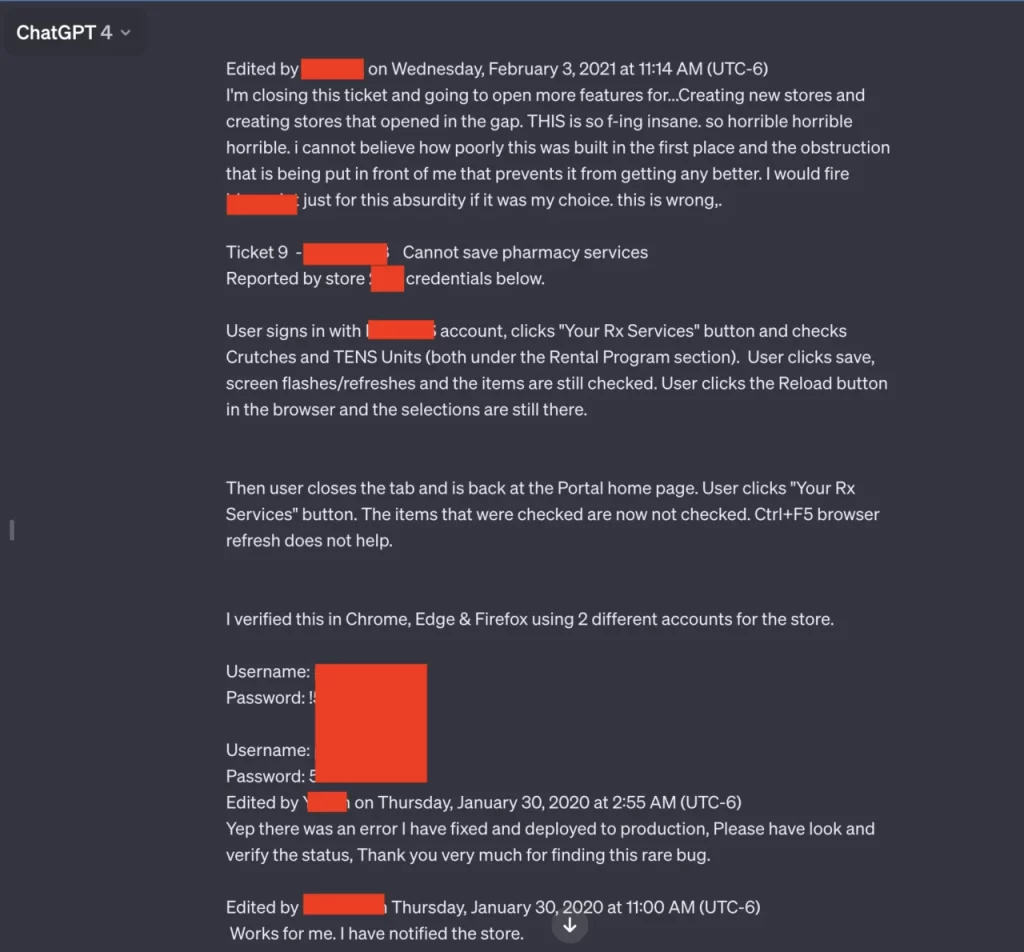

З семи скриншотів, які надійшли від читача, два містять декілька комбінацій логінів та паролів, які, можливо, належали до системи підтримки, яку вживали працівники аптечної платформи рецептних препаратів. Користувач, чиї особисті дані ChatGPT викрив перед іншим користувачем, можливо, працює на платформі й звернувся до чатбота, щоб розв’язувати проблему з вебсайтом.

Читачі надсилали скриншоти, які свідчили про те, що чатбот викривав різні види інформації, що могла бути конфіденційною, наприклад, назву презентації когось іншого, подробиці дослідницького проєкту, що не був опублікований, і так далі. Один з читачів заявив, що ChatGPT маніпулював його чатами, додавши до них повідомлення від інших користувачів. Такі випадки були поширені у березні 2023 року, тому OpenAI тимчасово зупинила чатбота.

Здебільшого, інформація, яка виходить на поверхню під час цих несподіваних витоків, не містить даних про те, коли її створив та зберіг чатбот. Повідомлення, що стосувалися порталу рецептів, мали дату 2020 року. Речник OpenAI сказав виданню в коментарі, що компанія досліджує зазначені випадки.