Компанії штучного інтелекту прагнуть дізнатися, про що думає ваш чат-бот, і це може стосуватися і вас

Коротко

- Більше 40 провідних дослідників у сфері штучного інтелекту пропонують моніторинг внутрішніх «ланцюгів мислення» чат-ботів, щоб виявити небезпечні наміри до їх реалізації.

- Експерти з питань конфіденційності попереджають, що моніторинг процесів мислення цих AI може розкрити чутливі дані користувачів і створити нові ризики для нагляду чи зловживань.

- Дослідники та критики погоджуються, що необхідні суворі заходи безпеки і прозорість, щоб цей засіб захисту не став загрозою для приватності.

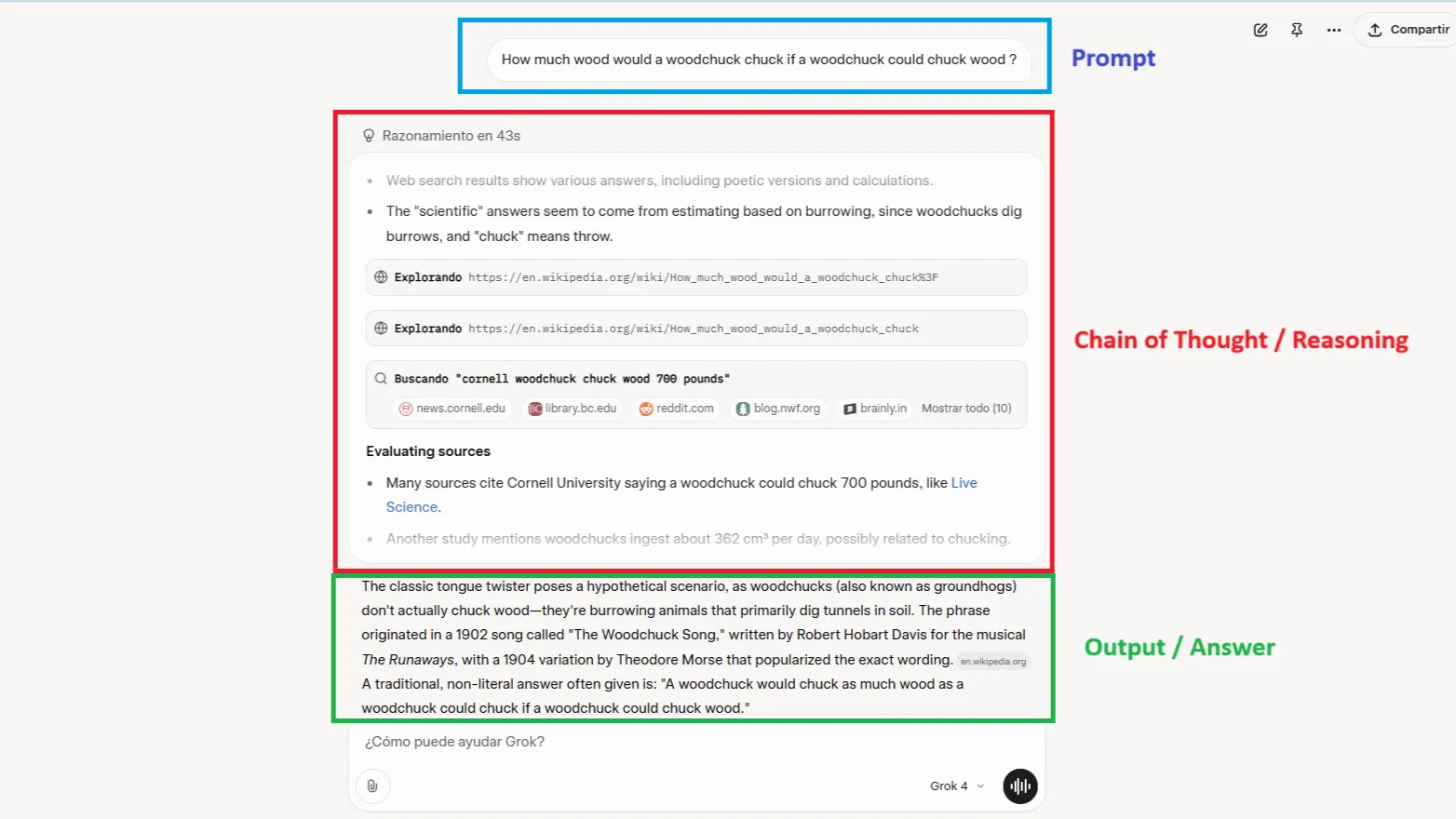

Сорок провідних дослідників у галузі штучного інтелекту опублікували роботу, в якій стверджують, що компанії повинні почати аналізувати думки своїх AI-систем. Не їхнє вихідне повідомлення – а власний процес когнітивної діяльності, внутрішній монолог, який відбувається перед тим, як ChatGPT або Claude дадуть відповідь.

Пропозиція, що отримала назву моніторинг «ланцюгів мислення», має на меті запобігання неправомірній поведінці ще до того, як модель сформулює відповідь, і може допомогти компаніям встановлювати оцінки «при ухваленні рішень щодо навчання та впровадження», стверджують дослідники.

Але є один нюанс, який повинен насторожити кожного, хто колись вводив приватне запитання в ChatGPT: якщо компанії можуть моніторити думки AI під час роботи (коли AI взаємодіє з користувачами), їм також доступно все інше.

Коли безпека перетворюється на нагляд

«Ця тривога обґрунтована,» прокоментував Нік Адамс, генеральний директор комерційного стартапу 0rcus. «Сира »ланцюг думки« часто містить в собі безпосередні секрети користувачів, оскільки модель ‘мислить’ тією ж самою інформацією, яку вона споживає.»

Все, що ви вводите в AI, проходить через його ланцюг думки. Проблеми зі здоров’ям, фінансові труднощі, зізнання – все це може бути зафіксовано і проаналізовано, якщо моніторинг не контролюється належним чином.

«Історія на боці скептиків,» попередив Адамс. «Метадані телекомунікацій після 11 вересня та журнали трафіку інтернет-провайдерів після Закону про телекомунікації 1996 року були введені ‘для безпеки’, а згодом перепрофільовані для комерційної аналітики та запитів. Така ж ймовірність чекає на архіви »ланцюга мислення«, якщо зберігання даних не буде криптографічно забезпечено, а доступ до них юридично обмежено.»

Генеральний директор Career Nomad Патріс Вільямс-Ліндо також обережний щодо ризиків цього підходу.

«Ми вже бачили цю практику. Пам’ятаєте, як соціальні мережі починалися з ‘з’єднайте своїх друзів’ і перетворилися на економіку спостереження? Аналогічний потенціал і тут,» зазначила вона.

Вона прогнозує «театральний консенсус», в якому «компанії будуть здаватися такими, що поважають конфіденційність, але вчергове закопають нагляд за »ланцюгами мислення« у 40-сторінкових умовах.»

«Без глобальних принципів, журнали »ланцюгів мислення« використовуватимуться для всього: від таргетингу реклами до ‘оцінки ризику співробітників’ у корпоративних інструментах. Слідкуйте за цим, особливо у технологіях HR та продуктивності AI.»

Технічна реальність робить це особливо тривожним. Моделі штучного інтелекту здатні на складне, багатоетапне міркування тільки за допомогою «ланцюга думки». Оскільки AI стає потужнішим, моніторинг стає і необхіднішим, і більш інвазивним.

Крім того, існуючий моніторинг «ланцюга думки» може бути дуже крихким.

Високопродуктивні RL, альтернативні архітектури моделей, деякі форми процесуального нагляду тощо можуть призвести до моделей, які затемнюють своє мислення.

– Боун Бейкер (@bobabowen) 15 липня 2025

Тедж Каліанда, дизайнер в Google, не проти цієї пропозиції, але підкреслює важливість прозорості, щоб користувачі могли бути впевненими, що відбувається з AI.

«Користувачам не потрібна вся внутрішня інформація моделі, але їм потрібно знати, чому вони бачать те, що бачать,» зазначила вона. «Добре розроблений інтерфейс може зробити з непроникного чорного ящика більш прозору конструкцію.»

Вона також додала: «У традиційних пошукових системах, таких як Google Search, користувачі можуть бачити джерело кожного результату. Вони можуть перейти до сайту, перевірити його надійність і ухвалити рішення. Ця прозорість дає користувачам відчуття контролю та впевненості. З AI-чат-ботами цей контекст часто зникає.»

Чи є безпечний шлях вперед?

Ім’я безпеки, компанії можуть дозволяти користувачам відмовлятися від збору своїх даних для навчання, але ці умови можуть не застосовуватися до «ланцюга думки» моделі – бо це вихід AI, який не контролюється користувачем – а моделі AI зазвичай відтворюють інформацію, яку користувачі надають, щоб здійснити правильне міркування.

Отже, чи існує рішення, яке підвищить безпеку, не порушуючи приватність?

Адамс пропонує запровадити заходи безпеки: «Мітки на основі пам’яті з нульовим терміном зберігання, детермінований хешування персональних даних перед зберіганням, редагування з боку користувача та диференційний шум на будь-якій агрегованій аналітиці.»

Але Вільямс-Ліндо залишається скептичною. «Нам потрібен AI, який відповідає за свої дії, а не виконує показові дії – і це означає прозорість, закладену в дизайні, а не нагляд за замовчуванням.»

Для користувачів наразі це не є проблемою – але може стати такою, якщо не буде реалізована належним чином. Технології, що можуть запобігти катастрофам з AI, також можуть перетворити кожну розмову з чат-ботом на зафіксовану, проаналізовану і потенційно монетизовану інформацію.

Як попереджав Адамс, слід очікувати «витоку, який розкриє сирі »ланцюги думки«, або публічної перевірки, яка покаже >90% ухилення, незважаючи на моніторинг, чи нових законодавчих актів у ЄС чи Каліфорнії, які класифікують »ланцюги думок« як захищені персональні дані.»

Дослідники закликають до запровадження заходів безпеки, таких як мінімізація даних, прозорість щодо моніторингу та швидке видалення незначних даних. Але їх реалізація вимагатиме довіри до тих самих компаній, які контролюють моніторинг.

Але у міру підвищення здатностей цих систем, хто буде стежити за спостерігачами, якщо вони можуть читати наші думки?

Related Posts

Кіберзлочинність: Чи стане це єдиною сферою, де штучний інтелект не зможе замінити людей?

Сенсаційний арешт у Сінгапурі: Чоловіка засудили за викрадення $6,9 млн у криптовалюті SafeX!