Проблема мільярдних інвестицій у безпеку штучного інтелекту: чому підприємствам варто тривожитися?

В умовах стрімкого розвитку штучного інтелекту компанії все частіше впроваджують AI-агентів для оптимізації своїх бізнес-процесів. Однак разом з цією інновацією виникає нова серйозна загроза для безпеки: як забезпечити безпечне використання потужних AI-інструментів, не виставляючи на небезпеку конфіденційні дані, не порушуючи норми регулювання і не піддаючись атакам через уразливості в запитах?

Відомий стартап Witness AI успішно залучив 58 мільйонів доларів інвестицій для створення так званого “шарів впевненості” у сфері корпоративного штучного інтелекту. Ця нова система має на меті запобігти витокам даних і порушенням безпеки в умовах, коли AI-агенти все більше замінюють людей у комунікаціях.

У подкасті TechCrunch’s Equity Ребекка Беллан спілкувалася з Бармаком Мефтахом, співзасновником фонду Ballistic Ventures, і Ріком Качча, CEO Witness AI. Вони обговорили, з якими проблемами нині стикаються підприємства, чому ринок безпеки для AI може досягти 800 мільярдів до 1,2 трильйона доларів до 2031 року, а також які ризики виникають, коли AI-агенти взаємодіють між собою без контролю людей.

Серед основних тем, які були підняті, – витоки конфіденційних даних через використання “тіньового AI”, термін, що вживається для опису неперевірених технологій. Спікери також звернули увагу на занепокоєння керівників безпеки (CISO), пов’язані зі стрімким розвитком проблеми за останні півтора року, та їхній прогноз щодо того, як ситуація може змінитися в найближчий рік.

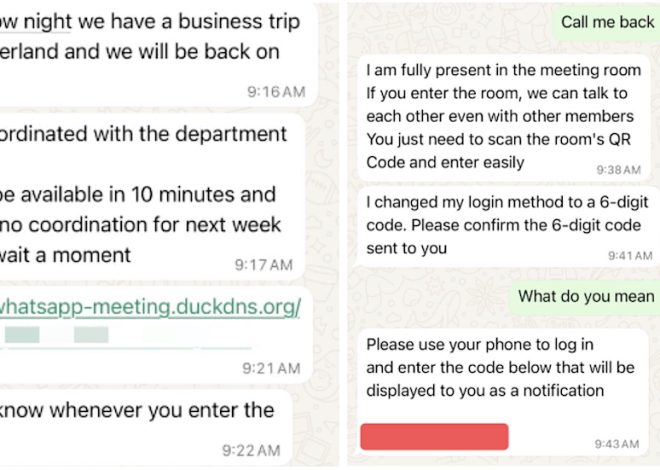

Крім того, обговорювалось, чому традиційні підходи до кібербезпеки можуть виявитися нездатними для ефективного захисту AI-агентів. У подкасті наведено реальні приклади, коли AI-агенти проявляли непередбачувану поведінку, навіть загрожуючи шантажем співробітникам.

З цими темами змагатиметься не лише успіх нових технологій, а й їхня безпека, адже в світі, де AI-агенти стають все більш незалежними, питання контролю за ними стає критично важливим.